Small Screen Cinema

Small Screen Cinema

Personalisierung als Medium der Klassifikation in postkinematischen Anordnungen

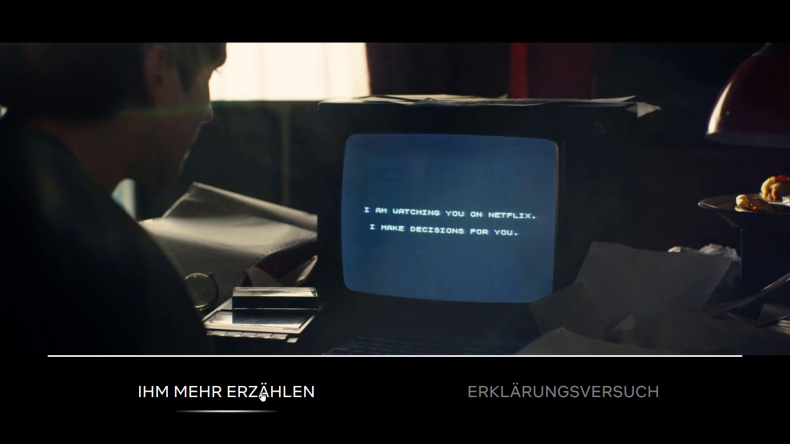

In einem der Entscheidungspfade des interaktiven Films BLACK MIRROR: BANDERSNATCH (UK/USA 2018) trifft die Zuschauer*in auf eine Szene, die wie ein Meta-Kommentar zu ihrer eigenen Zuschauer*inposition wirkt (Clip 1): Die Hauptfigur Stefan Butler, ein Spielprogrammierer, befindet sich dabei vor seinem Computerbildschirm und fragt sichtlich verzweifelt: „Wer ist da? Wer bist Du?“ Die Zuschauer*in hat die Entscheidungsmöglichkeit, ein Netflix- oder Weggabelungssymbol auszuwählen. Klickt man auf das Netflix-Symbol, wird selbstreflexiv auf Stefans Monitor eingeblendet: „Ich schaue Dich auf Netflix an. Ich entscheide, was Du tust.“ (vgl. Header-Abbildung)

Seinem eintretenden Vater erklärt Stefan, nachdem die Zuschauer*in die Unterhaltung per Wahl abbricht: „Jemand aus der Zukunft kontrolliert mich.“ In Szene gesetzt wird hier das Problem der Kontrolle und der Kontrollinstanz, das das Dispositiv des individualisierten Zuschauens durchzieht (vgl. dazu Distelmeyer 2012: 41–60; Hilderbrand 2009: 7–10; Stauff 2005: 203–259). Während der Dialog die Kontroll- und Entscheidungsmöglichkeit klar der interaktiven Zuschauer*in zuschreibt, ist es kaum übersehbar, dass die Szene sich auch umdrehen oder zumindest verkomplizieren lässt: Die Zuschauer*in ist zugleich in der Position des diegetischen Protagonisten, für den die Entscheidungen getroffen werden und der seinerseits kontrolliert wird. Wie Stefan sitzt sie vor einem kleinen digitalen Screen – nur dass sie vermutlich ein Smartphone mit einem berührbaren Interface statt einem Computermonitor mit Tastatur und Maus vor sich hat, um BANDERSNATCH zu steuern. Zum einen schaut sie, losgelöst von der Dunkelheit und der Kollektivität des Kinos, allein und bestimmt individuell, was und wie sie schaut. Gewöhnlich trifft sie aber keine Entscheidungen für narrative Pfade in einem interaktiven Film, sondern für die Filme selbst, zwischen denen eher Verhaltenspfade in einer App oder auf einer Streaming-Plattform entstehen. Zum anderen werden ihr diese Filme aber von Netflix’ algorithmischem Empfehlungssystem vorgeschlagen, das auf Basis des vergangenen Sichtungsverhaltens der Zuschauer*in personalisierte Vorschläge machen, Vorentscheidungen für sie treffen und auf ihr zukünftiges Verhalten Einfluss nehmen soll (vgl. Alexander 2016; Arnold 2016). BANDERSNATCH reflektiert über die Individualisierung des Zuschauens hinaus damit auch die algorithmische Personalisierung, die ausgerechnet als Medium der Empfehlung und Entscheidung diskursiviert wird (vgl. Muhle/Wehner 2016). Ist in der Dialogvariante die Kontrollmacht eindeutig bei der Zuschauer*in, so verteilt sie sich in der zweiten Lesart zwischen der Zuschauer*in und der Streaming-Plattform, verwischt sich gar in einem algorithmischen Steuerungsloop. Verweist die erste Lesart auf die Autonomiediskurse des individualisierten Zuschauens, so bricht die zweite diese durch die Ideologiekritik der algorithmischen Personalisierung, die den Film BANDERSNATCH zugleich dem Verdacht aussetzt, im Modus der Interaktion in Wahrheit die Vorlieben der Zuschauer*innen für diegetisch präsentierte Konsumprodukte zu erheben (vgl. Henning 2020).

Die BANDERSNATCH-Szene verhandelt damit den Status der digitalen Zuschauer*innenschaft, wie sie mittlerweile alltäglich ist: Filme und postkinematisch entgrenzte Bewegtbilder werden heute auf kleinen vernetzten Bildschirmen in stationären oder mobilen Anordnungen angeschaut. Auf internetfähigen Fernsehern, Laptops, Tablets und Smartphones können Filme zuhause, in Hotels, in öffentlichen Verkehrsmitteln oder auf öffentlichen Plätzen individuell konsumiert werden. Die Filme begegnen uns auf diesen Small Screens in verschiedenen Formen: als Langfilme, die vom Anfang bis zum Ende oder in mehreren Sitzungen angeschaut werden können; in serialisierter Form; in Form eines Ausschnitts oder Filmclips (Werbetrailer, Filmszenen auf YouTube oder Social Media); in postkinematischen Kurzformen wie GIFs oder Memes u.v.m. Auf diese greifen wir vermittelt über Plattformen oder Apps zu, die das Zuschauen in der Regel datafizieren und algorithmisch auswerten. Dabei stellen Small Screens einen zentralen Bezugspunkt der digitalen Zuschauer*innenschaft verschiedener medialer Inhalte dar: Filme sind nur ein Teil einer medialen Ökologie, die Serien, Spiele, Fernsehshows, Social-Media-Bilder und Nachrichten jeder Art einschließt. Neben der Wahl für bestimmte Inhalte treffen die Small-Screen-Zuschauer*innen auch eine Entscheidung für bestimmte Medien, was ein Wissen über mediale Differenzen voraussetzt wie gleichermaßen produziert. Als mediales Hybrid – diskursiviert als interaktiver Film, vermarktet als Teil der Anthologie-Serie BLACK MIRROR, verglichen mit Computerspielen – verkörpert BANDERSNATCH diese mediale Ökologie, die Fragen nach der (Macht-)Position der Zuschauer*in sowie der Medienspezifizität und -unspezifizität des digitalen Zuschauens aufwirft. Im Folgenden möchte ich die Individualisierung und Personalisierung der Zuschauer*innen als wichtige Charakteristika der zeitgenössischen Small-Screen-Anordnungen untersuchen und insbesondere zwei Arten der Differenzen miteinander in Beziehung setzen: mediale Differenzen, die klassischerweise Aufschluss über historische und zeitgenössische Medienspezifika geben können, und Zuschauer*innen-Differenzen. Während die Screen-Größe als eine zentrale mediale Differenz eingeführt wird, werde ich entlang der Personalisierung die Zuschauer*innen-Differenzen thematisieren. Die These ist, dass Individualisierung als Beschreibungskategorie für Small-Screen-Anordnungen nicht mehr ausreicht und um Personalisierung – verstanden als vernetzte und datafizierte Form der individualisierten Filmrezeption – ergänzt werden muss. Personalisierung möchte ich dabei nicht nur als ein Medium der Empfehlung und Entscheidung begreifen, sondern als Medium der Klassifikation und damit auch der Differenzproduktion, die gleichermaßen Filme wie Zuschauer*innen zum Gegenstand hat. Nach einer theoretisch-diskursiven Auseinandersetzung mit den Small-Screen-Anordnungen und den relevanten Konzepten kehre ich zu Netflix als einem konkreten, mit BANDERSNATCH aufgerufenen Fallbeispiel zurück, um die Verschränkung der verschiedenen Differenzkategorien herauszuarbeiten.

Big/Small Screen

Wenn es zu einer alltäglichen Erfahrung geworden ist, Filme auf kleinen Bildschirmen zu betrachten, so scheint es naheliegend, die Differenz zwischen Big und Small Screen konzeptionell ernst zu nehmen. Für Wissenschaftler*innen und Filmemacher*innen, die das Kino mit einer großen Leinwand und Projektion gleichsetzen, mag es dagegen illegitim erscheinen, die individualisierten Rezeptionsformen unter dem Begriff Small Screen Cinema zu vereinen. Denn Small Screen wird traditionell mit dem Fernsehen assoziiert (vgl. Creeber 2013; Hill/McLoone 1996; Newmann/Levine 2012: 100–128). Die Kleinheit des Bildes, die häufige Zerstreuung, der Mangel an Spektakularität, Kollektivität oder umhüllender Dunkelheit des Kinosaals werden, wie Martine Beugnet aufgearbeitet hat, vielfach gegen Filmrezeption auf kleinen Bildschirmen wie Smartphone angeführt und als Degradierung des Kinematografischen verstanden (vgl. Beugnet 2013: 199–200). Solche Wertedebatten belegen allerdings auch, inwiefern die Screen-Größe zu einer kontroversen wie produktiven medialen und medienhistorischen Differenz avanciert, die zur Reevaluierung der unterschiedlichen Rezeptionsmodi und ihrer Genealogien führen kann. So ist etwa laut Haidee Wasson die „Aesthetics of Size“ eine Schlüsselkategorie, um die digitale Transformation des Filmischen zu verstehen (2007: 74). In ihren Studien zu filmischen Formaten begreift sie Screens als zentrale Elemente der (post-)kinematischen Infrastruktur. Wie sie am Kontrast zwischen QuickTime-Movies und IMAX demonstriert, beeinflusst die Bildschirmgröße den Spielraum der ästhetischen Ausdrucksmöglichkeiten, die Herausbildung bestimmter Bildgenres und der Rezeptionsmodi. Während kleine Screens und miniaturisierte Ästhetiken zu einer intimen, possessiven, häuslich-alltäglichen Rezeptionsform einladen, ermöglichen gigantische Bildschirme die Erfahrung des Spektakulären und mithin des Erhabenen (vgl. ebd.: 87–90). Wasson identifiziert so deutlich zwei verschiedene Wahrnehmungsanordnungen, die durch die Bildschirm- bzw. Leinwandgröße differenziert sind.

Ein vergleichbares Spannungsverhältnis findet sich auch in Francesco Casettis (2015) Überlegungen zur Relokalisierung. Für ihn ist die Ko-Existenz kleiner, körpernaher und großer Screens nicht nur ein Kennzeichen der postkinematografischen Relokalisierungsbewegungen. Vielmehr schwingt in seiner Unterscheidung zwischen der Relokalisierung des Filmischen auf der einen und der Relokalisierung des Kinematografischen auf der anderen Seite die Größendifferenz mit (vgl. ebd.: 47–59): Die Relokalisierung des Filmischen umkreist tendenziell die Migration der Filme auf nicht-theatrale, häufig häusliche Orte und kleine Bildschirme wie Smartphone, Computer und TV. Die Relokalisierung des Kinematografischen thematisiert dagegen das Aufgreifen des Kinodispositivs an nicht-theatralen Orten wie Museum oder Kirche sowie in Form der großen Screens wie Medienfassaden. Screen-Größe wird hier zu einem Bezugspunkt für die Konzeption der medialen Differenzen und Erfahrungen, die den Medienbegriff nicht auf eine historisch spezifische Technik und Materialität reduzieren will (vgl. ebd.: 20–24). Oder anders: Mediale Differenzen werden aus Erfahrungsdifferenzen der Zuschauer*innen abgeleitet.

Wasson und Casetti knüpfen an die Differenz zwischen Big und Small Screen somit weitere Unterscheidungen wie theatral/nicht-theatral, spektakulär/alltäglich, kollektiv/individuell sowie visuell/taktil. Beide haben diese Leitunterscheidungen für historische Analysen – etwa des analogen portablen Kinos – fruchtbar gemacht, die die Gleichsetzung von Small Screen Cinema mit digitalen Filmanordnungen und Big Screen mit analogem Kino verhindern. Auch medienarchäologische Arbeiten von Erkki Huhtamo und Wanda Strauven, die sich der Geschichte der Small Screens widmen, führen das produktive Distinktionspotenzial der Bildschirmgröße vor. Beide beschäftigen sich mit den Archäologien, in denen kleine Screens taktile Rezeptionsmodi in primär visuelle (Bewegtbild-)Medien einführen. Beide zeigen auf, dass Filmrezeption verschiedene historische Formen der Individualisierung kennt und letztere keine kontingente Degradierung des Mediums im 21. Jahrhundert darstellt: Während Huhtamo eine den zeitgenössischen Relokalisierungsbewegungen vergleichbare „Gulliverisierung der Medien“ (2011: 336) bereits für das 19. Jahrhundert diagnostiziert, die durch das Spannungsverhältnis zwischen spektakulärer Monumentalisierung und taktil-possessiver Miniaturisierung der visuellen Screen-Medien gekennzeichnet ist (vgl. ebd.: 336–339), geht Strauven (vgl. 2012) taktilen Rezeptionsformen des Filmischen nach, die lange vor der Einführung der Smartphones als neuer Orte des Filmschauens existiert haben.

Bemerkenswerterweise sind es das Smartphone und seine berührbare Oberfläche, die die zeitgenössischen Debatten um das Small Screen Cinema, die Relokalisierung des Filmischen und damit die mediale Differenz zwischen Big und Small Screen dominieren und um die sich diskursiv die Vorstellung einer individualisierten Filmrezeption organisiert. Dabei wird Taktilität als ein entscheidendes Element dieser Rezeptionsformen isoliert und der Geschichte des kinematografischen und filmischen Okularzentrismus entgegengehalten (vgl. Beugnet 2013: 204–205; Strauven 2019: 74–76; Schneider 2012). Wie in BANDERSNATCH verbinden sich diese Verhandlungen auch mit Fragen und Geschichten der Interaktivität (vgl. Huhtamo 2005: 9; Strauven 2011). Ich möchte an diese produktiven Diskursivierungen und Historisierungen anschließen, um den zeitgenössischen Formen von Small Screen Cinema und ihren Modi der individualisierten Zuschauer*innenschaft nachzugehen. Gleichwohl möchte ich die Debatte in eine andere Richtung lenken. Denn die zitierten Arbeiten konzentrieren sich m.E. zu einseitig auf Aspekte der Ästhetik, taktiler Wahrnehmung und Erfahrung und vernachlässigen Probleme der Macht und der Subjektivierung. Auch die Tatsache, dass Small Screens heute vernetzte Formen der Filmsichtung mit sich bringen, findet in diesem spezifischen, der Screen-Größe als Leitdifferenz gewidmeten Diskurs kaum eine Berücksichtigung, sodass Individualisierung tendenziell auf Taktilität verengt und auch von den Auseinandersetzungen mit der Personalisierung – die etwa die Fernsehwissenschaften und Serialitätsforschung bereits selbstverständlich reflektieren (vgl. u.a. Alexander 2016; Arnold 2016; Novak 2017) – abgeschnitten wird.

Individualisierung/Personalisierung

Wenn von der Individualisierung der Zuschauer*in die Rede ist, so ist diese nicht ausschließlich von kollektiver Kinorezeption abgesetzt. Wie bereits angemerkt, scheint vielmehr die Fokussierung auf die Taktilität als Kennzeichen der zeitgenössischen Small Screens diskursiv zentraler zu sein, d.h. die Wahrnehmungsdifferenz visuell/taktil überlagert die soziale Differenz kollektiv/vereinzelt. Entgegen der dominanten Diskursivierung handelt es sich hierbei allerdings weniger um qualitative synästhetische Formen der taktilen Wahrnehmung bzw. der „haptischen Visualität“ (in Anlehnung an Marks 2002: 2), sondern vorrangig um Steuerungs- und Kontrollgesten – um eine taktile Manipulation der Filmrezeption. Die Eingriffe werden durch taktil bedienbare Schnittstellen bzw. „Komplementärmedi[en]“ (Engell 2003: 75) wie Fernbedienung, Maus, Tastatur oder Touch Screen ermöglicht. An die Kontrollfunktion der Individualisierung schließt sich die Selektion an: Diese Individualisierung geht mit einer persönlichen Selektionsmöglichkeit einher. Ob in Form von illegalem Download, legalen Video-on-Demand-Angeboten oder anderweitigen Streams – typischerweise sitzt die Small-Screen-Zuschauer*in wie in BANDERSNATCH vor einem Interface mit einer Datenbankstruktur, einem Menü oder einem Feed, aus denen sie/er wählen kann. Die Interfaces, ein zentraler Schauplatz digitaler Serialität (vgl. Mader/Wentz 2014: 130–138), präsentieren die Filme und andere Bewegtbilder vorzugsweise in serialisierter Form – angeordnet in Reihen, Listen oder Kacheln aus Titeln und/oder Thumbnails. Hinzu kommt die individuelle Verfügung über die Zeitlichkeit des Filmschauens. Die individualisierte Temporalität erstreckt sich dabei auf mehrere Ebenen. Timing: Der Film kann zu einer selbstgewählten Zeit unabhängig von Kino- und TV-Programmstrukturen betrachtet werden. Tempo: Man kann über den Zeitpunkt hinaus auch die Zeitlichkeit des Sichtungsprozesses manipulieren: den Film pausieren, wiederholen, zurückspulen, beschleunigen, unterbrechen und später wieder anschauen. Häufig gehen in Small-Screen-Anordnungen solche taktilen Manipulationen auf externe Störungen zurück: Die Lautsprecheransage in der Bahn oder im Flugzeug, der Schaffner im Zug oder die Nachricht auf einem Second Screen wirken sich auf die Temporalität der Sichtung aus.

Natürlich gab es in der Geschichte des Films verschiedene Formen der individualisierten Zuschauer*innenschaft, die mit manueller Kontrolle einhergingen – etwa im Falle von optischen Spielzeugen, Peepshows, Edisons Kinetoskop, Formen des analogen Home Cinemas oder der portablen Filmanordnungen für Militär oder Bildungseinrichtungen (vgl. Singer 1988; Strauven 2012; Wasson 2009, 2012). Dennoch scheint vor allem das Video ein wichtiges Medium im Übergang von analogen zu digitalen Orten des Films darzustellen. Es nahm zeitgenössische On-Demand- und Streaming-Kulturen als ‚Kulturen des Zugangs‘ vorweg, in denen die Rezeption noch stärker individualisiert ist und die Zuschauer*innen das abrufen können, was sie wollen, wann sie wollen (vgl. Hilderbrand 2009: 10). Dies gilt nicht zuletzt für die temporalen, selektierenden und sozialen Aspekte der Individualisierung, die auf das Medium Video und den Videorecorder zurückverweisen. Laut Siegfried Zielinski ist der Videorecorder eine „Zeitmaschine“ (1986: 315–331). Video als Medium hängt eng mit dem Fernsehen zusammen. Es antwortet auf die institutionellen Erfordernisse und das individuelle Bedürfnis, Fernsehinhalte, inklusive relokalisierter Filme, aufzeichnen und speichern zu können. Die Manipulierbarkeit wurde zum einen durch Time-Shift und Aufzeichnungsfunktionen und zum anderen durch typische videografische Playback-Operationen wie Stop, Play, Fast Forward oder Rewind ermöglicht. Der Videorecorder transformierte dabei die televisuelle Zeitstruktur. Die Erfahrung sozialer Teilhabe, die durch die zeitliche Synchronisation der TV-Rezeption vermittelt wurde, wich der Segmentierung und Individualisierung (vgl. ebd.: 327). Mit der Aufzeichnungsmöglichkeit und den käuflichen VHS-Kassetten entstehen zugleich Modi der Archivierbarkeit und Selektierbarkeit filmischer Inhalte.

Die videografischen Funktionen der „Zeitmaschine“ sind heute in digitalen Interfaces – von Smart TV über YouTube-Video bis hin zu TikTok – remediatisiert. Diese Form der temporal-manuellen Individualisierung und Flexibilisierung stellt zweifellos einen Freiheits- und Kontrollzuwachs für die Zuschauer*innen dar. Dennoch ist sie ein Ergebnis und ein Effekt medialer Dispositive und kann nicht einfach mit der Abwesenheit von Macht verwechselt werden. Wie Markus Stauff (2005: 236–244) und Jan Distelmeyer (2012: 55–60) im Anschluss an Foucaults Dispositivbegriff argumentiert haben, sind zeitgenössische Formen flexibler Film- und Fernsehzuschauer*innenschaft ein Ausdruck gouvernementaler Regierungsformen und gouvernementaler Medialität. In individualisierten Anordnungen ist das Subjekt keines, „das in der Beschreibung eindeutiger Machtverhältnisse aufgeht, bei der entweder von der Entmachtung oder der Ermächtigung von Subjekten die Rede sein könnte“ (Distelmeyer 2012: 59). Genauer wird die „souveräne Individualität“ in der Kopplung von Apparaten und Körpern selbsttechnologisch bearbeitet – „eine Technologie, die Subjekte nicht nur hervorbringt, sondern diese zur Regierung des eigenen Selbst nötigt und befähigt“ (Stauff 2005: 242).

Allerdings scheint die gouvernementale Individualisierung und Flexibilisierung, die ihren diagnostischen Ausgang bei DVD und frühen Formen des digitalen, noch nicht internetfähigen Fernsehens hat, die heutigen Small-Screen-Cinema-Settings noch nicht hinreichend zu beschreiben. Denn diese sind generell vernetzt. Relokalisierte Filme und postkinematische Bewegtbilder werden so in datafizierten, algorithmizierten und nicht selten auch plattformisierten oder appifizierten Anordnungen betrachtet, etwa über Anbieter wie Netflix, Amazon Prime Video oder YouTube. Hierbei ist das Filmschauen über temporale und taktile Individualisierung hinaus auch personalisiert: Die Modi des individuellen Zugriffs, der Auswahl und der Kontrolle sind mit einem algorithmischen Steuerungs- und Empfehlungsregime verschaltet. Genau deshalb gilt es, den Small-Screen-Cinema-Diskurs und seine Fragen nach der medialen Differenz als Wahrnehmungsdifferenz zu verschieben und Small Screen Cinema stärker auf Personalisierung und die damit einhergehenden Differenz- und Machtlogiken zu beziehen. Die konkrete Funktionsweise der Personalisierungs- und Empfehlungsalgorithmen unterscheidet sich von Anbieter zu Anbieter, dennoch lassen sich einige Aspekte generalisieren: Personalisierung ist eine auf Basis von Verhaltensdaten gemachte Empfehlung. Daten werden erhoben, ausgewertet und verglichen, um Präferenzen über individuellen Geschmack sowie Interessen zu errechnen und entsprechende Konsumvorschläge zu machen. Personalisierung ist damit eine Form algorithmischer „Publikumsbeobachtung und Angebotssteuerung“, aber auch ein Medium der Entscheidung bzw. Entscheidungsmodulation (Muhle/Wehner 2016: 112). Dies wird von der herkömmlichen massenmedialen Angebotsstruktur abgesetzt, bei der einer Vielzahl von Zuschauer*innen-Zielgruppen, die mithilfe der sozialdemografischen Marktforschung gebildet sind, dieselben Produkte dargeboten werden, ohne dass Individuen mit ihren persönlichen Vorlieben zur Geltung kommen. „Vor diesem Hintergrund versprechen algorithmengesteuerte Internettechnologien eine Veränderung und ‚Verbesserung‘ der Medienkommunikation“ (ebd.: 113). Während die temporale Individualisierung das relokalisierte Filmschauen mit dem Medium Video verbindet, verweist die Personalisierung sie u.a. auf das Medium Fernsehen, seine Zuschauer*innenmessungen sowie Programmstrategien des Narrow- und Microcastings (vgl. dazu Novak 2017; Parks 2004).

Personalisierung macht sich die Interaktion zwischen den Zuschauer*innen und Interfaces, über die Filme ausgewählt werden, zunutze. Es handelt sich um eine mehr oder weniger dynamische Feedbackschleife, die von Vorwürfen der Überwachung und Ausbeutung begleitet wird (vgl. Zuboff 2019: 93–97). Zuschauer*innen-Verhalten wie Scrollbewegungen und Anklicken oder die Temporalität des Schauens selbst (wann, wie lange, wie oft, mit welchen videografischen Funktionen) werden verzeichnet. Die Bewertungen des Films, das Pflegen der Watchlists oder das Folgen eines Accounts werden ebenfalls registriert und algorithmisch ausgewertet. Für die Personalisierung sind demnach über hintergründig erhobene Verhaltensdaten hinaus auch aktiv eingegebene bzw. explizit erfragte Präferenzen der Nutzer*innen relevant (vgl. Unternährer 2021: 403). Das fließt wiederum zurück, um das Interface und die vorgeschlagenen Titel der prognostizierten Modellzuschauer*in anzupassen und auf ihr Sichtungsverhalten und weitere Interface-Interaktionen Einfluss zu nehmen. Man könnte auch pointieren, dass die Personalisierung Timing, Tempo und Kontrolle der individualisierten Zuschauer*in datafiziert, um auf die Individualität der Selektion algorithmisch Einfluss zu nehmen. Sie ist, kurz gesagt, eine profilbasierte und prognostische Regulation des zukünftigen Zuschauer*innen-Verhaltens. Datenbasierte Empfehlungs- und Personalisierungskulturen sind Kulturen des Experiments: Personalisierungen sind Hypothesenbildungen über zukünftiges Verhalten, die durch User*innen permanent verifiziert oder falsifiziert werden (vgl. Schrage 2020: 80–81).

Personalisierung lässt sich als ein Teilmechanismus algorithmischer Gouvernementalität begreifen, der Wissen um Zuschauer*innen und zugleich Wissen um Filme produziert. Das Konzept der algorithmischen Gouvernementalität geht auf Antoinette Rouvroy (2013) und ihre Co-Autor*innenschaft mit Thomas Berns (2013) zurück. Personalisierung ist dabei eines ihrer zentralen Beispiele. Algorithmische Gouvernementalität stellt eine Form der automatisierten Wissensproduktion, Hypothesenbildung und Regulierung des zukünftigen Verhaltens dar, die auf Sammeln und Speichern von Daten (Data Capture), Prozessieren und Auswerten von Big Data (Data Mining) und Profilbildung beruht (vgl. Rouvroy/Berns 2013: VI–IX). Die Machteffekte der algorithmischen Gouvernementalität richten sich auf Zukunft und Potenzialität; sie produzieren ein „probabilistic subject“ (Rouvroy 2013: 153). Es handelt sich um eine Strategie, die Unsicherheit, die mit dem menschlichen Handeln verbunden ist, zu minimieren und zu managen (vgl. ebd.: 155). Dieses Regime kontrastiert mit dem neoliberalen Modus des Regierens, der „hyper-subjects“ zur Voraussetzung hat, die durch Prozesse der Selbstkontrolle, des Selbstunternehmertums und der Selbstbewertung ständig zu sich selbst finden sollen (ebd.: 153). Algorithmische Gouvernementalität operiert dagegen auf der vorbewussten Ebene der Stimuli, Alarmsignale und Reflexe, statt die Subjekte in ein reflexives, intentionales oder interpretatives Verhältnis zu sich selbst zu setzen (vgl. ebd.), weshalb sie auch letztlich keine Subjektivierungsprozesse nach sich zieht: „Algorithmic governmentality is without subject: it operates with infra-individual data and supra-individual patterns without, at any moment, calling the subject to account for himself“ (ebd.: 144–145).

Die Machteffekte haben kein physisches Individuum, gefügige Körper oder normative Konformität mehr zum Ziel, wichtiger sind ein statistisches Datendouble und damit Relationen und Korrelationen in den Daten (vgl. Rouvroy/Berns 2013: XI–XII). Die Korrelationen werden in der Immanenz der Daten gesucht und verzichten auf statistischen Durchschnitt, Durchschnittsmenschen, Normalwert oder psychologische Motivation als Referenzpunkte (vgl. ebd.: IV–V). Ihnen eignet diskursiv deshalb das Versprechen, demokratischer zu sein und weniger Benachteiligungen zu produzieren – weil durch Multiplikation der Korrelationen das individuelle Profil immer weiter verfeinert werden kann, ohne klassische soziale, politische, ethnische, geschlechtliche oder religiöse Kategorien für die Profilierung und Regulation bemühen zu müssen, so Rouvroy und Berns – natürlich in kritischer Absicht (vgl. ebd.: IX). Doch genau diese letzten Punkte scheinen in mindestens zweierlei Hinsicht problematisch zu sein: Erstens entkoppeln die Autor*innen viel zu stark digitale und analoge Welten, indem sie keine Beziehung zwischen Datendoubles und User*innen sehen, die im Begriff des Profils m.E. gerade verbunden werden müssen. Bedenkt man die zahlreichen Einsatzgebiete der algorithmischen Gouvernementalität über Personalisierung hinaus – etwa Bildung, Versicherung, Gesundheit oder Jobsuche – und die Debatten über algorithmische Vorurteile und Rassifizierung (vgl. u.a. Bergermann 2019; Gates 2014; Monea 2019; O’Neil 2016; Wachter-Boettcher 2017), so kommt diese Entkopplung einer theorieinternen Depolitisierung nahe. Zweitens wirken die Schlussfolgerungen mit Blick auf konkrete Funktionsweisen der algorithmischen Personalisierungssysteme unvollständig und pauschal.

Netflix-Interface als Medium der Klassifikation

Wie sich am Beispiel von Netflix zeigen lässt, um zum Ausgangspunkt des Aufsatzes zurückzukehren, greifen bestimmte algorithmische Empfehlungsverfahren explizit auf vermeintlich überkommene soziodemografische Kategorien zurück. Ihre Wirkmacht erschließt sich besonders dann, wenn Personalisierungssysteme nicht nur als Medien der Entscheidung, sondern zugleich auch als solche der Klassifikation adressiert werden – als „Medien zur Einübung und Durchsetzung klassifikatorischer Praktiken“ (Gregory 2018: 37). Netflix’ Modell algorithmischer Wissensproduktion klassifiziert u.a. Zuschauer*innen und Filme, wobei die Small Screens und ihre Interfaces den Schauplatz ihrer Relationierung darstellen.

Klassifikation ist ein Prozess der Aufteilung und des Ordnens der Welt nach ausgewählten Prinzipien mit dem Ziel einer systematischen Vollständigkeit. Klassifikationen produzieren Differenzen und setzten sie nach spezifischen Logiken – etwa der Hierarchie, Ähnlichkeit, Genealogie oder Binarität – miteinander in ein Verhältnis. Ihnen ist eine bestimmte Politik eingeschrieben, wie Bowker und Star in Sorting Things Out, ihrem Buch über Klassifikationsinfrastrukturen schreiben:

Each standard and each category valorizes some point of view and silences another. This is not inherently a bad thing – indeed it is inescapable. But it is an ethical choice, and as such it is dangerous – not bad, but dangerous. (Bowker/Star 2000: 5f., Herv. i. O.)

Politiken der Wahl, Valorisierung oder Marginalisierung gehen nicht nur in die Herausbildung der Klassifikationssysteme ein, vielmehr sind sie als solche performativ. Sie setzen Differenzen in Kraft und verleihen ihnen Gewicht und Realität. So sind auch den Empfehlungssystemen, die versprechen, persönliche Differenzen zu verzeichnen, klassifikatorische Politiken eingeschrieben. Sie beinhalten und bringen etwa klassische Differenzen wie Gender, ‚Race‘ oder Alter performativ hervor.

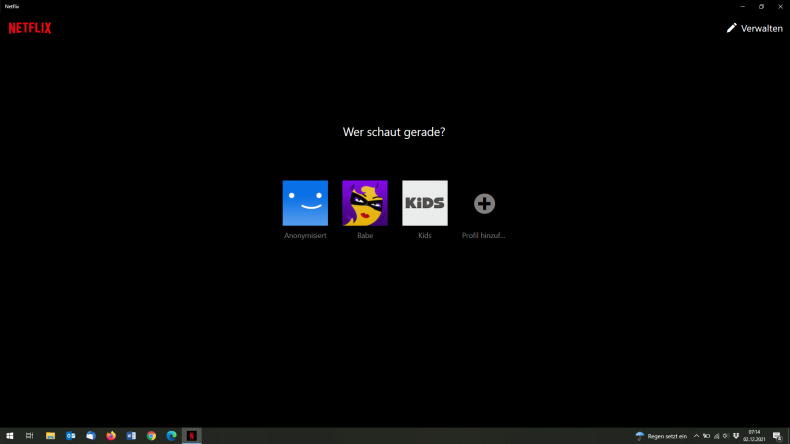

Ich möchte dies am Beispiel einer persönlichen Anekdote veranschaulichen. Vor einigen Jahren habe ich mir in einem mit einer weiteren Person geteilten Netflix-Account ein eigenes Profil angelegt. Selbstironisch habe ich dieses – unter Zuhilfenahme der Steuerungstasten meiner Fernbedienung – mit „Babe“ benannt (Abb. 1). Die Empfehlungsliste dieses Profils wurde sofort mit romantischen Komödien überschwemmt. Als eine Person, die Experimentalfilme, Mind Game Movies und Science-Fiction-Filme bevorzugt und als Teil eigener akademisch-kulturellen Distinktion begreift (zu Geschmacksdistinktionen vgl. Bourdieu 2018), war ich beleidigt. Ich wurde falsch klassifiziert. Dieses Überraschungsmoment führte zur Erkenntnis eines gegenseitigen Verfehlens, welches wiederum Differenzen produziert: Meine Selbstironie unterstellte fälschlicherweise, dass Algorithmen Humor verstehen können. Ich habe etwas anthropomorphisiert, was sich im Akt des Verfehlens als technisch herausgestellt hat. Die Vorschlagsliste mit romantischen Komödien lässt sich dabei als typisches Beispiel der algorithmischen Vorurteile begreifen. Mein Profil wurde kurzerhand gegendert und mit bestimmten Genderstereotypen unterfüttert.1 Der Akt des Verfehlens, der Fehl-Klassifikation, produziert mit der Differenz zwischen Menschlichem und Technischem auch die zwischen Technischem und Geschlechtlichem. In Anlehnung an Barad lässt sich diese visuell und manuell koordinierte Interaktion mit dem Interface treffender als Intra-Aktion bezeichnen, die einen agentiellen Schnitt vollzieht und so diskursiv-materielle Differenzen produziert (vgl. Barad 2012: 19–20).

Diese Anekdote verbildlicht, was der Begriff Personalisierung häufig rhetorisch verschleiert: Bei der Personalisierung handelt es sich selten einfach um die Verzeichnung und Auswertung individueller singulärer Vorlieben. Denn diese werden zugleich mit statistischen Größen, Vergleichsgruppen und demografischen Faktoren wie Gender oder Alter korreliert. Personalisierung impliziert auch mathematisch-statistische Formen der Kollektivierung, sie situiert eine Datenidentität in einer Matrix des Datenkollektivs. Auf Small Screens wird nicht nur vereinzelt, sondern auch ‚versammelt‘, und zwar im Rahmen der klassifikatorischen Differenzproduktion. So unterscheidet Markus Unternäher vier typische Empfehlungsverfahren, die unterschiedliche Grade der Singularisierung und der Kollektivierung beinhalten und in einem einzelnen System verbunden werden können: Popularitätsmetriken, stereotypisierende Verfahren, inhaltsbasierte Verfahren und kollaboratives Filtern (vgl. Unternäher 2021: 397). Bevor ich auf das stereotypisierende Verfahren und meine Anekdote zurückkomme, gilt es, die anderen Empfehlungsarten vorzustellen. Popularitätsmetriken und inhaltsbasiertes Filtern können dabei als zwei entgegengesetzte Pole eines Kontinuums betrachtet werden.

Inhaltsbasierte Empfehlungen sind im Gegensatz zu Popularitätsmetriken stark personalisiert. Sie kategorisieren Dinge, nicht Beziehungen zwischen Dingen und Nutzer*innen (,item-user matching‘) oder Nutzer*in und Nutzer*in (,user-user matching‘). Der Nutzer*in werden ähnliche Dinge auf Basis eines Suchbegriffs oder ehemaligen Sichtungsverhaltens vorgeschlagen, ohne dass automatisch viel Wissen über sie/ihn vorliegt. Auf Netflix entspricht dies z.B. der Kategorie „Weil Sie XYZ gesehen haben“. „Inhaltsbasierte Empfehlungssysteme scheinen zwar die einzelnen Nutzerinnen in ‚splendid isolation‘ zu betrachten, tatsächlich behandeln sie sie aber als Äquivalent zu Dingen“ (ebd.: 411). Auf Netflix zeigt sich eine Paradoxie dieser Personalisierung über ,item-item matchings‘, insofern über einen Film- oder Serienvorschlag nach ähnlichen Titeln gesucht werden kann: Obwohl hierbei die einzelne Zuschauer*in und ihr momentanes Interesse adressiert werden, werden einer anderen Zuschauer*in, die ähnliche Titel über denselben Film aufruft, dieselben Titel vorgeschlagen. Die Ähnlichkeitsachse verläuft auf der Produktebene, und diese Liste kann wiederum mehreren Zuschauer*innen unverändert vorgezeigt werden. Sprich: Klickt man etwa auf den Film THE MATRIX (USA/AUS 1999) unter zwei verschiedenen Profilen, werden dieselben Filmempfehlungen gemacht (THE MATRIX REVOLUTIONS, USA 2003; BATMAN FOREVER, USA 1995; SPIDER-MAN, USA 2002 etc.).

Popularitätsmetriken stehen in der Tradition von Musikcharts und Beststellerlisten. Sie unterstellen, dass Trends und Populäres alle gleichermaßen interessieren und imaginieren ein „diffuses Wir“ (ebd.: 406). Sie können Ergebnis von Datafizierung und Algorithmizierung sein, d.h. auf Auswertung der Nutzer*innen-Verhaltens auf einer Plattform zurückgehen, dennoch richten sie sich an viele Nutzer*innen auf gleiche Weise. Dabei sind Popularitätsmetriken nicht absolut. Sie beziehen sich auf eine Gruppe von Nutzer*innen und sind auf einen zeitlichen Rahmen begrenzt (populär letzten Monat, letzte Woche, heute etc.). Auf Netflix entspricht dies den Vorschlagskategorien wie „Heute Top 10 in Deutschland“, „Beliebt auf Netflix“ oder „Derzeit beliebt“. Obwohl die Auswahl der Titel in diesen Kategorien deutlich populäre Trends abbilden soll, sind die Kategorien unterschiedlich stark personalisiert, statt überhaupt nicht personalisiert zu sein: Während Top-10-Listen zwar dieselben Filme oder Serien vorschlagen, können sich von Profil zu Profil die Vorschlagsbilder unterscheiden. Personalisierung verschiebt sich hier von Produktempfehlung hin zur Produktpräsentation. Auch ein flüchtiger Blick auf „Derzeit beliebt“ oder „Beliebt auf Netflix“ zeigt schnell, dass die empfohlenen Titel und die Thumbnails sich vom Profil zu Profil unterscheiden und damit Popularitätsmetriken mit weiteren Personalisierungsverfahren mischen, wobei alle drei – inhaltsbasierte, kollaborative und stereotypisierende – Verfahren gleichermaßen in Frage kommen.

Kollaboratives Filtern ist eine Empfehlungsmethode, bei der Interessen einer Nutzer*in dadurch vorausgesagt werden sollen, dass sie mit Präferenzen einer größeren Nutzer*innen-Gruppe verglichen werden. Die Methode basiert auf zeitlichen Annahmen zur Ähnlichkeit: Menschen, die in der Vergangenheit ähnliche Dinge gemocht haben, werden es mutmaßlich in Zukunft ebenfalls tun (vgl. Schrage 2020: 245–246). Kollaboratives Filtern führt dabei eine doppelte Relationierung aus: Zuerst werden Ähnlichkeitsbeziehungen zwischen Nutzer*innen (,user-user matchings‘) und temporäre Nachbarschaften errechnet, auf die wiederum Nutzer*innen-Ding-Passungen (,user-item matchings‘) folgen (vgl. Unternährer 2021: 400–401, 412). Durch die Ähnlichkeit der Interaktionen sollen die Vertrauens- und Empfehlungsbeziehungen zwischen einander bekannten Personen simuliert bzw. ersetzt werden (vgl. ebd.: 416). Kollaboratives Filtern weist neben dem stereotypisierenden Filtern die stärksten Grade der Sozialisierung auf:

Personalisierung im Sinne einer singularisierenden Adressierung auf der Nutzungsoberfläche beruht ironischerweise auf algorithmischer, technisch hergestellter Sozialität; einer Sozialität, die in digitalen Infrastrukturen ohne das Wissen der Nutzerinnen hergestellt wird. Nutzerinnen, die nie in direkten Kontakt getreten sind oder jemals treten werden, ‚kooperieren‘ insofern, als ihre Bewertungen von Dingen zur Ressource für Empfehlungen für andere werden. Collaborative Filtering ermöglicht Kollaboration ohne Gemeinschaft. (ebd.: 413)

Diese Form ‚algorithmischer Sozialität‘ findet sich auch bei Netflix, dessen Set an Empfehlungsalgorithmen – auch bekannt als ,Cinematch‘ – dezidiert auf Kundenklustern basiert, ohne für die Zuschauer*innen offensichtlich zu werden. Netflix schafft stattdessen die Illusion einer Personalisierung und rückt das Clustering der Kunden zu „Geschmackgemeinschaften“ in den Hintergrund (vgl. Alexander 2016: 86; Zündel in Vorbereitung).

Während im Modell des kollaborativen Filterns Identitäten nicht zugeschrieben und Verhaltensänderungen im Laufe der Zeit berücksichtigt werden, werden Nutzer*innen im stereotypisierenden Empfehlungsverfahren als Mitglieder kategorialer Gruppen begriffen (vgl. Unternährer 2021: 413). Etablierte soziodemografische Kategorien wie Geschlecht, Alter, Wohnort oder Lebensstile dienen dabei als Kennwerte für Geschmacks- und Konsumpräferenzen, sodass die Verfahren wieder schwach personalisiert sind. Diese sind insofern stereotypisierend, „da sie auf Konvention und vermeintlichen Selbstverständlichkeiten beruhende Relationen zwischen Gruppen und Dingen herstellen“ (ebd.: 407) und etwa Actionfilme männlichen und romantische Komödien weiblichen Zuschauer*innen empfehlen. Solche Daten können beim Anlegen eines Profils abgefragt oder aus der Analyse des Verhaltens abgeleitet werden. Das heißt, dass vom Zuschauer*innenverhalten z.B. auf Gender geschlossen wird, indem ein Verhalten mit einem bestimmten Muster verglichen wird. „Stereotypisierende Empfehlungen unterstellen die Gleichheit aller einer Kategorie zugehörigen Nutzerinnen und einen Zusammenhang zwischen kategorialen Gruppen und zugehörigen Dingen“ (ebd.: 408). Demografisches Targeting ist ein Vorläufer dieser Form der Personalisierung, wobei beide ein fragmentiertes Publikum bzw. Gesellschaft voraussetzen. Bei stereotypisierenden Empfehlungen und früheren Formen des zielgruppenspezifischen Massenmarketings stehen das Publikum und die Produkte in einem ko-konstitutiven Verhältnis zueinander, insofern Produkte schon mit Blick auf bestimmte Publikumskategorien hergestellt werden (vgl. ebd.: 408–409), wie sich sicherlich auch an ,Netflix Originals‘ im Detail zeigen ließe. Stereotypisierende Empfehlungen folgen der sozialwissenschaftlichen Episteme, die die massenmediale Demografie- und Marktforschung prägte: Diese hat „an ascriptive conception of the individual: each individual could be assigned to a category, which could then be sociologically and culturally characterized” (Fisher/Mehozay 2019: 1180, Herv. i. O). In dieser Episteme wird das Publikum als Amalgam unterschiedlicher, aber in sich homogener sozialen Gruppen verstanden (vgl. ebd.).

Wie meine Anekdote zeigt, sind demografische Faktoren bei Netflix zum einen in das Profil eingebaut: Neben Gender werden auch Altersunterschiede errechnet und herangezogen, was etwa das von Netflix voreingestellte „Kids“-Profil veranschaulicht. Darüber hinaus bilden sich Geschlechter- und ‚Race‘-Differenzen in der hauseigenen Praxis der Genrebildung und Verschlagwortung ab, die wiederum die Produktion der ,Netflix Originals‘ mitbestimmt. Durch die Verschlagwortung und die Korrelation der Tags mit einem Profil werden den Zuschauer*innen demografisch vorklassifizierte Inhalte angeboten (vgl. Arnold 2016: 56). Die Plattform ordnet Profile dabei bestimmten Klassifikationen vermittels Genres zu und bestimmt, was Identität in ihrem algorithmischen System eigentlich bedeutet (vgl. ebd.). Im Web, so bemerkt auch Cheney-Lippold, nutzt die algorithmische Auswertung „statistical commonality models to determine one’s gender, class, or race in an automatic manner at the same time as it defines the actual meaning of gender, class, or race themselves. Ultimately, it moves the practice of identification into an entirely digital, and thus measureable [sic], plane“ (2011: 165).

Auf Netflix ist die geschlechtliche, rassifizierte und ethnische Klassifikationsarbeit in Tags offensichtlich, wie z.B. „Filme mit starker weiblicher Hauptrolle“, „African-American Action & Adventure from the 1970s“, „Chinese Gay & Lesbian Movies“ oder „Foreign Gay & Lesbian Dramas from the 1980s“, „Mexican Crime Movies“ oder „Indian Movies from the 1940s“.2 Netflix ist für seine Hyper-Klassifikation der Genres bekannt. Diese Hyper-Klassifikation kommt durch bezahlte Zuschauer*innen zustande, deren primäre Aufgabe es ist, Filme und Serien zu schauen und sie zu verschlagworten. Über 76.000 Mikrotags verzeichnet das 36-seitige Trainingsmanual, das u.a. auf die gezielte Analyse von Hollywoodfilmen zurückgeht (vgl. Madrigal 2014: o.S.). Auf dieser menschlichen Arbeit baut das Algorithmische auf. Netflix’ hyper-klassifizierte Genres folgen einer Grammatik, die bis zu acht Kategorien kombinieren kann (vgl. ebd.). Aufgrund der Zeichenbegrenzung auf dem Interface sieht die Zuschauer*in aber nicht die vollständige Verschlagwortung eines Titels, sondern mehr oder weniger bekannte Genres oder zugänglichere Klassifikationen (vgl. ebd.). Klassische Genres wie Drama, Komödie, Thriller oder Horror werden dabei mit Adjektiven wie „quirky“ (eigenartig), „psychological“, „raunchy“ (vulgär, dreckig), „spiritual“, „cerebral“ oder „visually striking“ versehen. Hinzu kommen die bereits angemerkten Angaben zu Gender, ‚Race‘, Nationalität und/oder Zeitraum. Solche Adressierungen können für die Zuschauer*innen potenziell identitätsstiftend wirken, weil sie die Zugehörigkeit zu einer bestimmten Gruppe suggerieren und so vergemeinschaften (vgl. Zündel in Vorbereitung). Obwohl diese potenziell unendliche Ausdifferenzierungspraxis durchaus als Netflix’ Bemühung um Diversität gelesen werden kann,3 stellt sich dennoch die Frage, was hier markiert und was hier nicht markiert wird. Oder nochmals anders: Wer wird hier eigentlich klassifiziert und wer nicht? So finden sich, wenig überraschend, auch keine Tags wie „white“, „American“ oder „male“, die einfach universalistisch als Ausgangspunkt der Klassifikation und Diversifikation vorausgesetzt werden. Manche sind eben mehr ‚klassifizierbar‘ als andere. Markiert werden marginalisierte oder nicht-normative Differenzen, d.h. Identitäten, die kulturell über Differenz und Andersheit codiert und damit schlicht politisch überdeterminiert sind (vgl. Arnold 2016: 57).

Fazit

Wenn also die algorithmische Gouvernementalität die Unsicherheit und Kontingenz des menschlichen Verhaltens managen soll, wie Rouvroy bemerkt (vgl. 2013: 155–156), dann ist klar, dass Netflix – als lediglich ein prominentes Beispiel für personalisiertes Zuschauen auf Small Screens – diese auch über Geschlecht, ‚Race‘ und nationale oder ethnische Identität verwaltet. Das Bild der Personalisierung muss deshalb komplexer betrachtet werden und ihre Formen des „statistical stereotypings“ (Cheney-Lippold 2011: 171) berücksichtigen können. Die algorithmische Kultur des Experiments stellt auch Hypothesen über normative und nicht-normative Identitäten an, die in der Interaktion mit der Plattform performativ werden. In der Serialität des wiederholten Zuschauens, durch die Habitualisierungseffekte von diesen algorithmisch-humanen Performanzen, werden Identitäten eingeübt, vollzogen und verworfen. Dies schlägt sich auf dem personalisierten Interface in serieller Form der Vorschlagslisten und Vorschaubilder nieder.

Dabei wird neben dem Wissen um Zuschauer*innen auch das um Filme codiert und produziert. Obwohl Personalisierung – aber auch Individualisierung – auf Netflix nichts Typisches für das Filmzuschauen ist, sondern vor allem für das Schauen auf Small Screens und deshalb genauso für Serien oder Fernsehshows Gültigkeit hat, ist es dennoch nicht gleichgültig, was man schaut. Netflix’ algorithmisch-humanes Empfehlungssystem basiert nicht nur in seiner Entwicklungsgeschichte hauptsächlich auf einem Filmwissen und damit auf ,reverse engineering‘ von Hollywood (vgl. Madrigal 2014: o.S.). Darüber hinaus generiert die Datafizierung auch Wissen über mediale Vorlieben der Zuschauer*innen. Dieses Wissen fließt wiederum in die Empfehlungen und die hauseigenen Produktionen ein, wie etwa an HOUSE OF CARDS (USA 2013–2018) diskutiert wird (vgl. exemplarisch Finn 2016: 87–112). In anderen Worten: Selbst unter Bedingungen der Medienkonvergenz werden mediale Distinktionen nicht obsolet. Sie leben fort als Bestandteil der datafizierten Klassifikationen und Medienproduktionen. Bei Netflix produziert die Klassifikation nach Genres, Microtags und Altgenres ein unendlich ausdifferenzierbares Wissen um medial-ästhetische Artefakte, das zwar für Filmwissenschaftler*innen und Zuschauer*innen opak, aber durch seine performativen und ästhetisierten Darbietungen auf dem Interface erfahrbar ist. Die Klassifikation fungiert sowohl medienübergreifend als auch mediendifferenzierend, d.h. Netflix’ Empfehlungskategorien markieren mediale Differenzen (z.B. Film, Serien, Stand-Up-Comedy, Underground-Filme, „Filme mit starker weiblicher Rolle“) oder maskieren sie in übergreifenden Kategorien wie „Beliebt auf Netflix“. Das Netflix-Interface, samt Verschlagwortung und Thumbnails, ist ein Medium der Klassifikation, das Zuschauer*innen-Differenzen und mediale Differenzen miteinander in Verbindung setzt. Es ist eine „unablässig ratternde Differenzmaschine […], ein Apparat, der laufend neue Unterscheidungen erzeugt“ (Gregory 2018: 38) und der in Form der heutigen vernetzten Small Screens allgegenwärtig ist.

- 1Genre und Gender sind in der Produktion und Vermarktung eng verbunden. Gehören Gender und sexuelle Differenz zu den wichtigsten Bestandteilen von Genres, so laufen beide diskurshistorisch auch immer Gefahr einer wechselseitigen Essentialisierung – gerade, wenn die geschlechtsspezifische Genrezuordnung entlang der heterosexuellen Matrix und binärer Gendervorstellungen verläuft (vgl. u.a. Gradinari 2020: 178).

- 2Die Liste ist einsehbar unter: https://www.whats-on-netflix.com/library/categories/ (Zugriff: 16.09.2021).

- 3Das Unternehmen bemüht sich selbsterklärtermaßen um mehr Diversität vor und hinter der Kamera (vgl. Serandos 2021). Die Rezeption ist diesbezüglich gespalten. Neben enthusiastischem Lob wird auch viel Kritik geäußert, dass Netflix Diversity-Diskurse für Profit- und Marketingzwecke vereinnahmt und sie so ihres sozialpolitischen Kapitals beraubt werden (vgl. Farr 2016; Maly-Bowie 2019). Neben Diskussionen zu Gender und ‚Race‘ gibt es kritische Positionen zur Rolle der Nation und Netflix’ transnationalen Bemühungen, die u.a. von Vorwürfen des Kulturimperialismus begleitet werden (vgl. u.a. Lobato 2019).

Alexander, Neta (2016) Catered to Your Future Self: Netflix’s ‚Predictive Personalization‘ and the Mathematization of Taste, in: McDonald, Kevin/Smith-Rowsey, Daniel (Hg.) The Netflix Effect: Technology and Entertainment in the 21st Century, New York: Bloomsbury, S. 81–97.

Arnold, Sarah (2016) Netflix and the Myth of Choice/Participation/Autonomy, in: McDonald, Kevin/Smith-Rowsey, Daniel (Hg.) The Netflix Effect: Technology and Entertainment in the 21st Century, New York: Bloomsbury, S. 49–62.

Barad, Karen (2012) Agentieller Realismus. Über die Bedeutung materiell-diskursiver Praktiken. Berlin: Suhrkamp.

Bergermann, Ulrike (2019) Es kommt der neue Algorithmus. Fotofilter und kollektive Normierungen, in: Ruelfs, Esther/Beyerle, Tulga (Hg.) Amateurfotografie. Vom Bauhaus zu Instagram, Heidelberg: Kehrer, S. 104–111.

Beugnet, Martine (2013) Miniature Pleasures: On Watching Films on an iPhone, in: Geiger, Jeffrey/Littau, Karin (Hg.) Cinematicity in Media History, Edinburgh: Edinburgh University Press, S. 196–210.

Bourdieu, Pierre (2018) Die feinen Unterschiede. Kritik der gesellschaftlichen Urteilskraft. Frankfurt/Main: Suhrkamp.

Bowker, Geoffrey C./Star, Susan Leigh (2000) Sorting Things Out: Classification and Its Consequences. Cambridge/London: MIT Press.

Casetti, Francesco (2015) The Lumière Galaxy. Seven Keywords for the Cinema to Come. New York: Columbia University Press.

Cheney-Lippold, John (2011) A New Algorithmic: Identity Soft Biopolitics and the Modulation of Control, in: Theory, Culture & Society 28, Nr. 2, S. 164–181.

Creeber, Glen (2013) Small Screen Aesthetics. From TV to the Internet. Basingstoke/London: Palgrave Macmillan/BFI.

Distelmeyer, Jan (2012) Das flexible Kino. Ästhetik und Dispositiv der DVD & Blu-ray. Berlin: Bertz + Fischer.

Engell, Lorenz (2003) Tasten, Wählen, Denken. Genese und Funktion einer philosophischen Apparatur, in: Münker, Stefan/Roesler, Alexander/Sandbothe, Mike (Hg.) Medienphilosophie. Beiträge zur Klärung eines Begriffs, Frankfurt/Main: Fischer, S. 53–77.

Farr, Brittany (2016) Seeing Blackness in Prison: Understanding Prison Diversity on Netflix’s ORANGE IS THE NEW BLACK, in: McDonald, Kevin/Smith-Rowsey, Daniel (Hg.) The Netflix Effect: Technology and Entertainment in the 21st Century, New York: Bloomsbury, S. 155–169.

Finn, Ed (2016) What Algorithms Want: Imagination in the Age of Computing. Cambridge: MIT Press.

Fisher, Eran/Mehozay, Yoav (2019) How Algorithms See Their Audience: Media Epistemes and the Changing Conception of the Individual, in: Media, Culture & Society 41, Nr. 8, S. 1176–1191.

Gates, Kelly (2014) Can Computers Be Racist? in: Juniata Voices 15, S. 5–17.

Gradinari, Irina (2020) Genre und Gender, in: Stiglegger, Marcus (Hg.) Handbuch Filmgenre. Geschichte – Ästhetik – Theorie, Wiesbaden: Springer VS, S. 171–198.

Gregory, Stephan (2018) Ranking, Sorting, Classing. Klassifikation und Klassenkampf um 1700, in: Zeitschrift für Medienwissenschaft 19, Nr. 2, S. 36–47.

Henning, Martin (2020) Medialität, Ästhetik und Ideologie des interaktiven Films auf Netflix. Das Beispiel BLACK MIRROR: BANDERSNATCH, in: Nach dem Film 18, siehe: https://www.nachdemfilm.de/index.php/issues/text/medialitaet-aesthetik-und-ideologie-des-interaktiven-films-auf-netflix (Zugriff: 17.09.2021).

Hilderbrand, Lucas (2009) Inherent Vice: Bootleg Histories of Videotape and Copyright. Durham/London: Duke University Press.

Hill, John/McLoone, Martin (Hg.) (1996) Big Picture, Small Screen. The Relations Between Film and Television. Luton: University of Luton Press.

Huhtamo, Erkki (2005) Slots of Fun, Slots of Trouble: An Archaeology of Arcade Gaming, in: Raessens, Joost/Goldstein, Jeffrey (Hg.) Handbook of Computer Game Studies, Cambridge: MIT Press, S. 3–21.

Huhtamo, Erkki (2011) Botschaften an der Wand. Eine Archäologie von Mediendisplays im öffentlichen Raum, in: Sommer, Gudrun/Hediger, Vinzenz/Fahle, Oliver (Hg.) Orte filmischen Wissens. Filmkultur und Filmvermittlung im Zeitalter digitaler Netzwerke, Marburg: Schüren, S. 331–348.

Lobato, Ramon (2019) Netflix Nations: The Geography of Digital Distribution. New York: New York University Press.

Madrigal, Alexis C. (2014) How Netflix Reverse-Engineered Hollywood, in: The Atlantic, Januar 2014, o.S., siehe: https://www.theatlantic.com/technology/archive/2014/01/how-netflix-reverse-engineered-hollywood/282679/ (Zugriff: 17.09.2021).

Maeder, Dominik/Wentz, Daniela (2014) Digital Seriality as Structure and Process, in: Eludamos: Journal for Computer Game Culture 8, Nr. 1, S. 129–149.

Maly-Bowie, Barbara (2019) ‚Home is Where Your Netflix is‘ – From Mobile Privatization to Private Mobilization, in: Literary Geographies 5, Nr. 2, S. 216–233.

Marks, Laura (2002) Touch: Sensuous Theory and Multisensory Media. Minneapolis/London: University of Minnesota Press.

Monea, Alexander (2019) Race and Computer Vision, in: Sudmann, Andreas (Hg.) The Democratization of Artificial Intelligence: Net Politics in the Era of Learning Algorithms, Bielefeld: Transcript, S. 189–208.

Muhle, Florian/Wehner, Josef (2016) Algorithmus und Entscheidung. Anspruch und Empirie personalisierter Medienangebote im Internet, in: Conradi, Tobias/Hoof, Florian/Nohr, Rolf F. (Hg.) Medien der Entscheidung, Berlin: LIT, S. 111–130.

Newman, Michael Z./Levine, Elana (2012) Legitimating Televsion. Media Convergence and Cultural Studies. New York/London: Routledge.

Novak, Alison N. (2017) Narrowcasting, Millennials and the Personalization of Genre in Digital Media, in: Barker, Cory/Wiatrowski, Myc (Hg.) The Age of Netflix: Critical Essays on Streaming Media, Digital Delivery and Instant Access, Jefferson: McFarland, S. 162–181.

O’Neil, Cathy (2016) Angriff der Algorithmen. Wie sie Wahlen manipulieren, Berufschancen zerstören und unsere Gesellschaft gefährden. München: Hanser.

Parks, Lisa (2004) Flexible Microcasting: Gender, Generation, and Television-Internet Convergence, in: Spigel, Lynn/Olsson, Jan (Hg.) Television after TV: Essays on a Medium in Transition, Durham/London: Duke University Press, S. 133–161.

Rouvroy, Antoinette (2013) The End(s) of Critique: Data-Behaviourism vs. Due-Process, in: Hildebrandt, Mireille/de Vries, Katja (Hg.) Privacy, Due Process and the Computational Turn. Philosophy of Law Meets Philosophy of Technology, Abington: Routledge, S. 143–167.

Rouvroy, Antoinette/Berns, Thomas (2013) Algorithmic Governmentality and Prospects of Emancipation. Disparateness as a Precondition for Individuation Through Relationships? in: Réseaux 177, Nr. 1, S. III–XXXI.

Sarandos, Ted (2021) Inklusion verwirklichen: Ergebnisse aus unserer ersten Diversity-Studie zu Filmen und Serien von Netflix, in: Netflix, siehe: https://about.netflix.com/de/news/building-a-legacy-of-inclusion (Zugriff: 17.09.2021).

Schrage, Michael (2020) Recommendation Engines. Cambridge: MIT Press.

Singer, Ben (1988) Early Home Cinema and the Edison Home Projecting Kinetoscope, in: Film History 2, Nr. 1, S. 37–69.

Schneider, Alexandra (2012) The iPhone as an Object of Knowledge, in: Snickars, Pelle/Vonderau, Patrick (Hg.) Moving Data: The iPhone and the Future of Media, New York: Columbia University Press, S. 49–60.

Stauff, Markus (2005) Das neue Fernsehen. Machtanalyse, Gouvernementalität und digitale Medien. Münster: LIT.

Strauven, Wanda (2011) The Observer’s Dilemma: To Touch or Not to Touch, in: Huhtamo, Erkki/Parikka, Jussi (Hg.) Media Archaeology: Approaches, Applications, and Implications, Berkeley/Los Angeles: University of California Press, S. 148–163.

Strauven, Wanda (2012) The Archaeology of the Touch Screen, in: Maske und Kothurn 58, Nr. 4, S. 69–79.

Unternährer, Markus (2021) Die Ordnung der Empfehlung, in: Kölner Zeitschrift für Soziologie und Sozialpsychologie 73, S. 397–423.

Wachter-Boettcher, Sara (2017) Technically Wrong: Sexist Apps, Biased Algorithms, and Other Threats of Toxic Tech. New York/London: W.W. Norton & Company.

Wasson, Haidee (2007) The Networked Screen. Moving Images, Materiality, and the Aesthetic of Size, in: Marchessault, Janine/Lord, Susan (Hg.) Fluid Screen, Expanded Cinema, Toronto: University of Toronto Press, S. 74–95.

Wasson, Haidee (2009) Electric Homes! Automatic Movies! Efficient Entertainment! 16mm and Cinema’s Domestication in the 1920s, in: Cinema Journal 48, Nr. 4, S. 1–21.

Wasson, Haidee (2012) Suitcase Cinema, in: Cinema Journal 51, Nr. 2, S. 148–152.

Zielinski, Siegfried (1986) Zur Geschichte des Videorecorders. Berlin: Spiess.

Zuboff, Shoshana (2019) The Age of Surveillance Capitalism. The Fight for the Future at the New Frontier of Power. London: Profile Books.

Zündel, Jana (in Vorbereitung): Empfehlungen als Endlosschleife. Zur seriellen Ästhetik der Content-Vernetzung bei Netflix, in: Moskatova, Olga/Mücke, Laura (Hg.) Bild | Kanäle. Zur Theorie und Ästhetik vernetzter Medienkultur, Würzburg: Königshausen & Neumann.